時間に関する常識を理解するタスクにおいて世界1位を記録しました

MC-TACOを使ったタスクにおいて世界1位の精度を記録

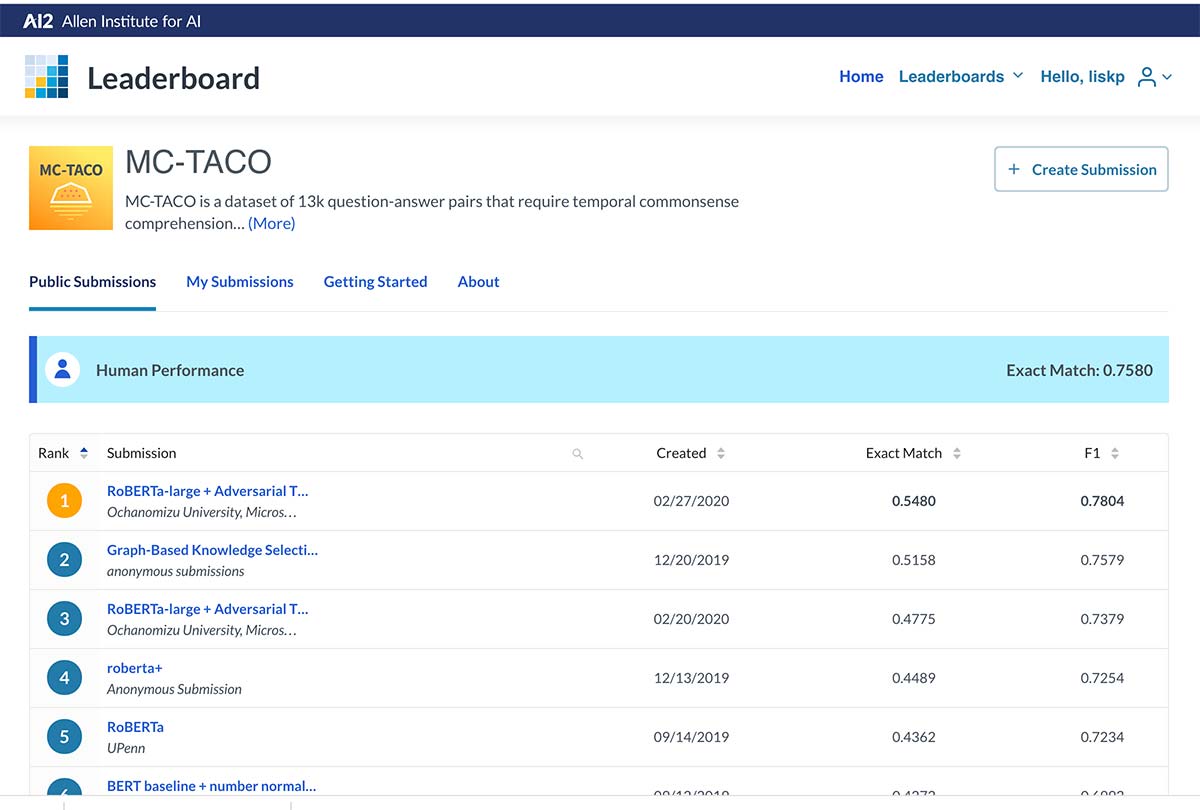

お茶の水女子大学Lis Kanashiro Pereira特任助教とその共同研究者らは、時間関係に関する常識を質問応答する課題MC-TACOにおいて世界1位の精度を記録しました。

時間に関する常識的な知識は、自然言語の中に表現される出来事を理解するためにしばしば必要となります。この知識は時間に関する様々な出来事(例:間隔、頻度、時間順序)を含んでいます。ほとんどの人は、「休暇に行く」というような出来事は、「散歩に行く」というよりも、しばしば時間が長いことを知っていると思います。しかし、このような時間に関する常識をコンピュータに理解や推論させることは、未だ挑戦的な課題になっています。

近年、文脈事前学習言語モデルが、様々な常識に関する自然言語課題(Kocijan et al., 2019; He et al., 2019)に対して、研究の最先端を押し進めてきています。

私たちの研究において、文脈事前学習言語モデルRoBERTa(Liu et al., 2019)の時間常識能力を調査しました。RoBERTaはBERTにおける言語マスキングの方法(Devlin et al., 2019)に基づいて構築され、ハイパーパラメータの調整や訓練データのサイズなどの改良を含み、BERTに比べて下流の課題に対して、より良く一般化することを示しています。

Jiang et al. (2019)の研究に影響を受け、私たちは敵対的訓練方法を用い、大規模の言語モデルをファインチューニグする際に典型的に生じる過学習と知識の忘却問題を軽減し、構築したモデルに対してMC-TACO dataset (Zhou et al. 2019)を用いて評価を行いました。このデータセットは13,000の時間的な常識を把握することを必要とする質問応答ペアから成り立っています。この課題の公式リーダーボードにおいて、私たちはF1と完全一致スコアにおいて1位となりました。私たちは、顕著な量の常識的知識は文脈言語モデルの事前学習を通じて獲得され得るという先の研究成果を確認しました。

一方で、私たちのモデルは、依然、人間のパフォーマンスには遠く及ばす、この分野においてより一層研究を進めていきたいと思っています。